インタビュー:

インタビュー:

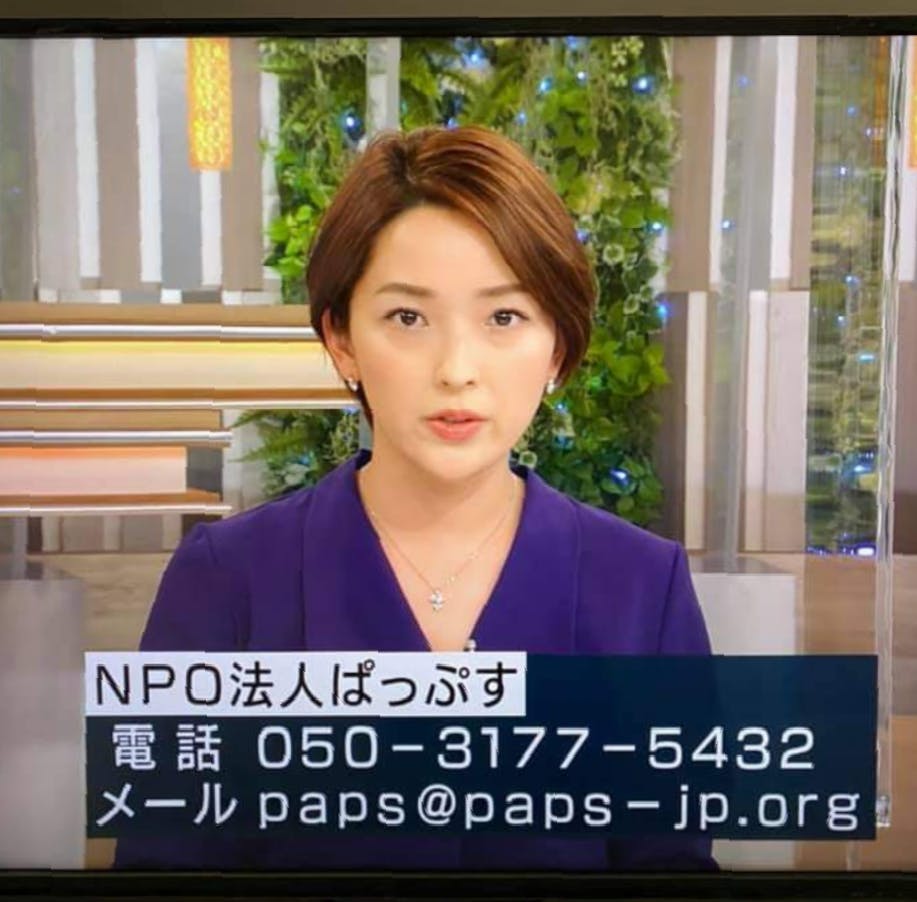

特定非営利活動法人ぱっぷす

理事長 金尻カズナ

聞き手 谷とも子

ーー ぱっぷすでは、性的搾取の被害に遭われた方の相談支援と、性的画像記録を撮影され拡散された被害の削除要請事業、さらに、刑事・民事事件化の支援をされていますね。

近年の傾向を教えていただけますか?

金尻 はい。いまの子どもたちは、中高生のうちから、児童ポルノ、リベンジポルノのデジタル性暴力に巻き込まれたという相談が後をたちません。前年に引き続き、アプリを通じて知り合った人から性行為を撮影され、アダルトビデオとしてインターネットで販売される被害相談が多く、また、例年に比べて盗撮被害の相談も増えています。撮影者は同級生、元/恋人、SNSで知り合った人、まったく知らない人物だったりもします。盗撮される場所は中学や高校、大学の校舎内であったり、元/恋人宅やホテル、もしくは全く覚えのない場所で盗撮されたケースもあります。盗撮された動画を用いて脅されたり、アダルトサイトに投稿/販売されているといったケースが増えています。

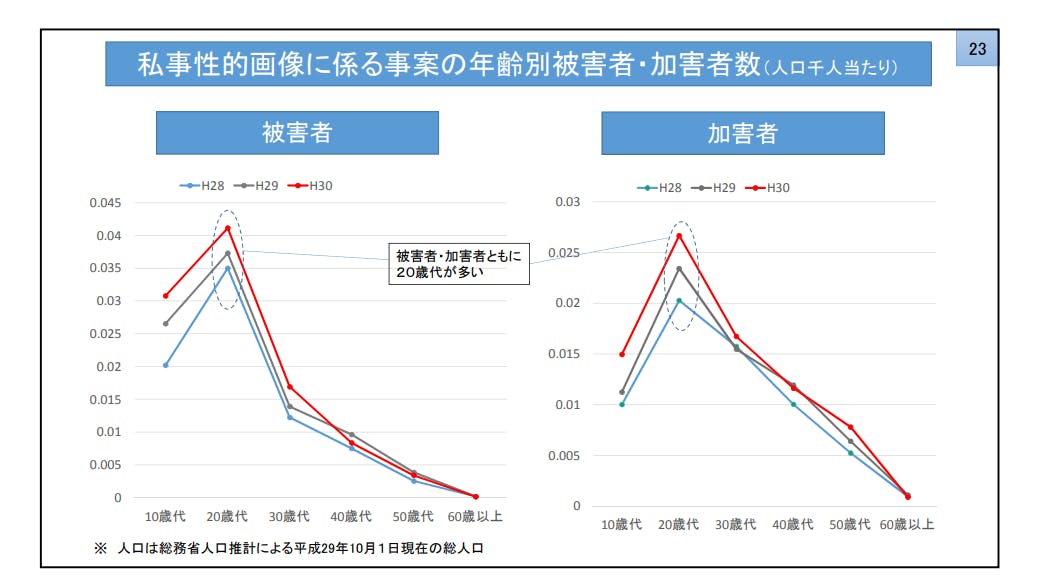

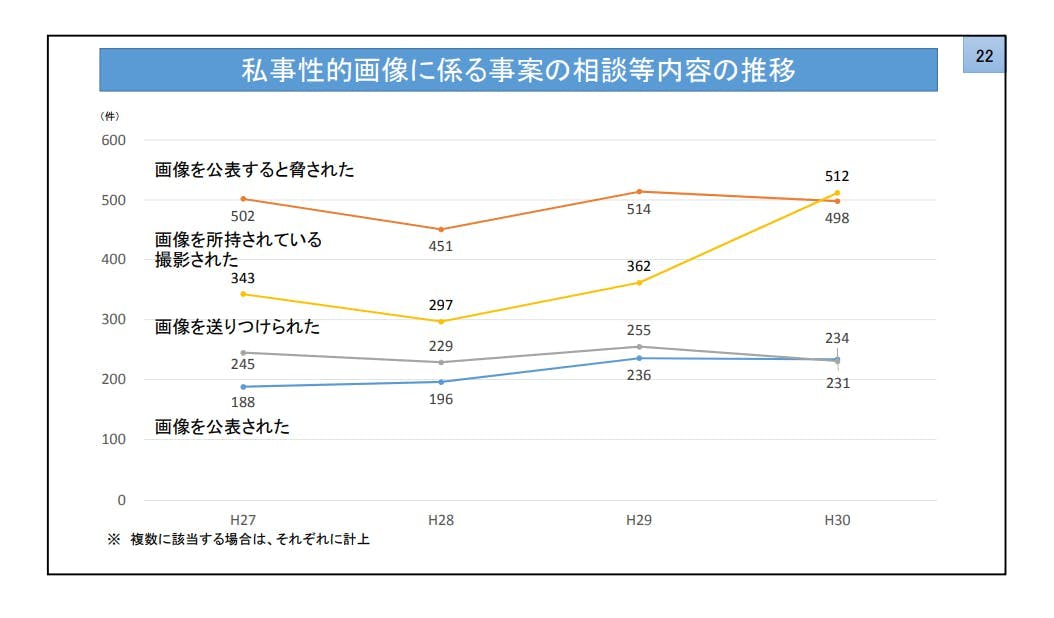

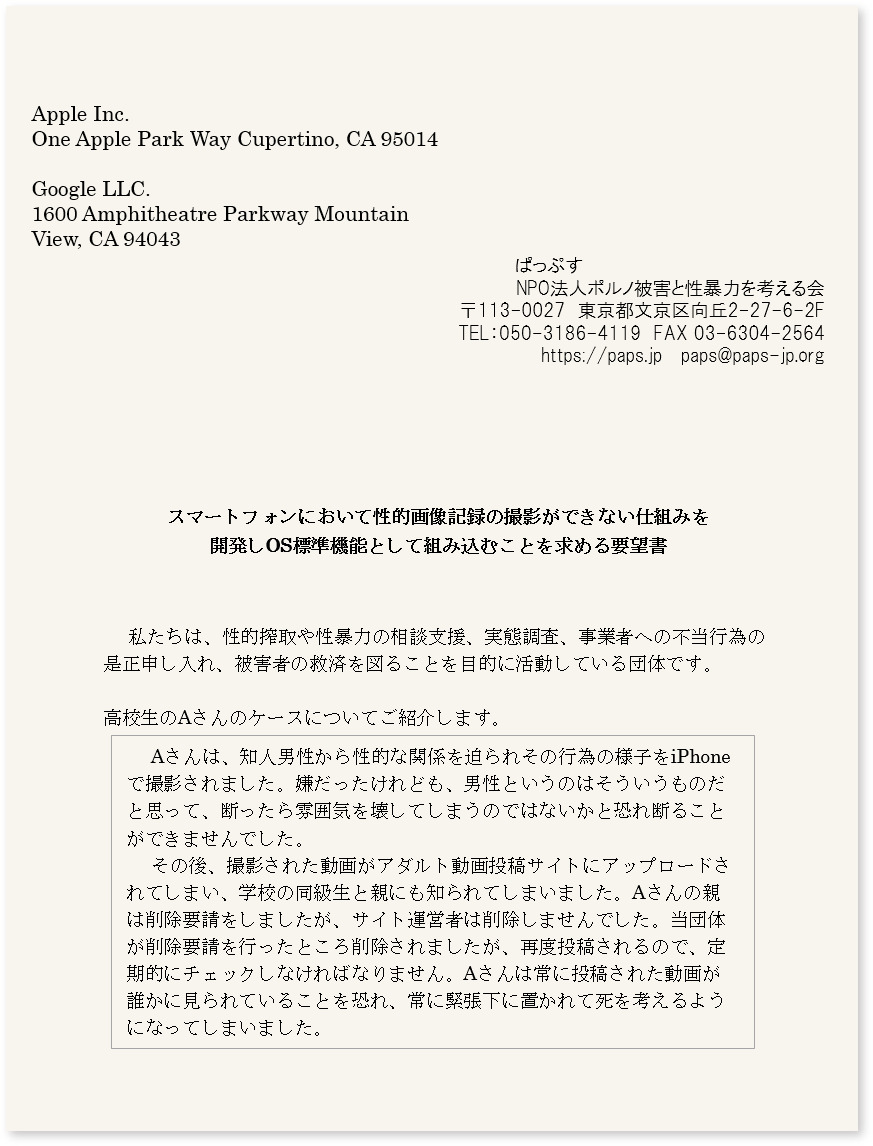

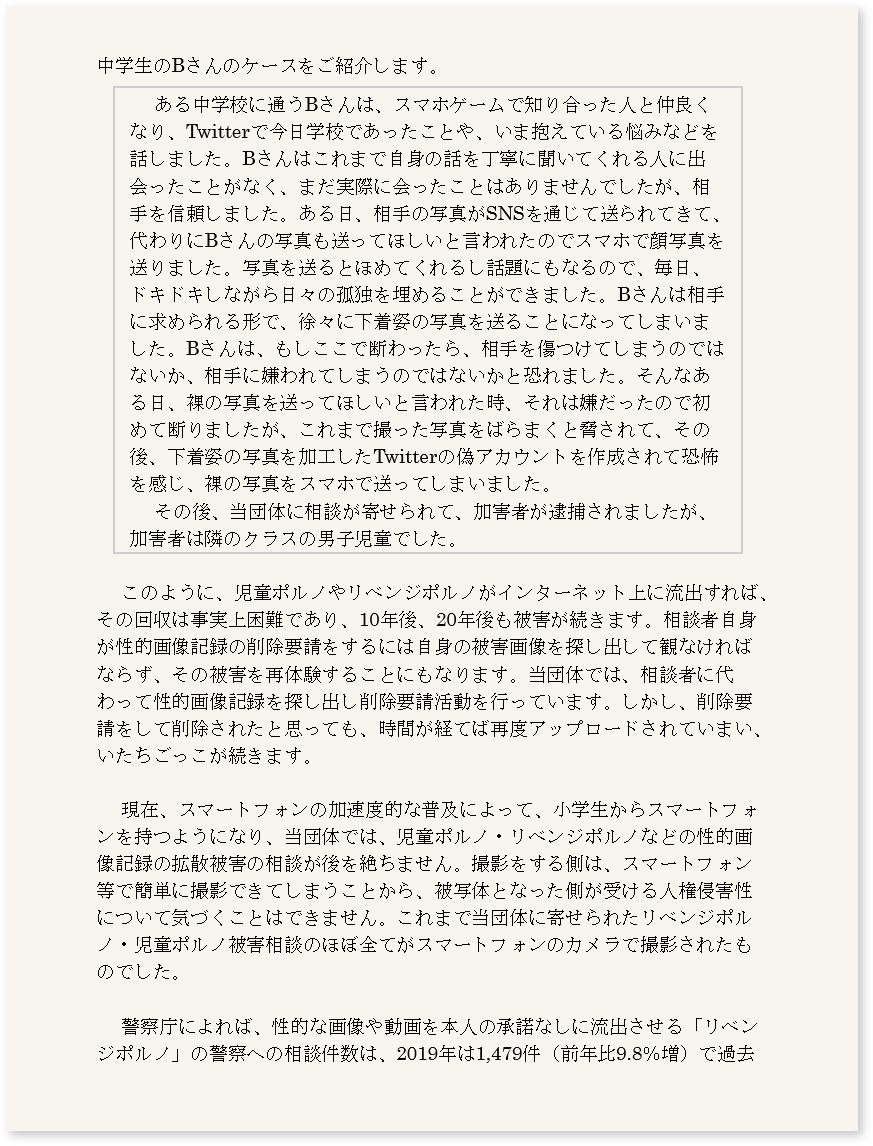

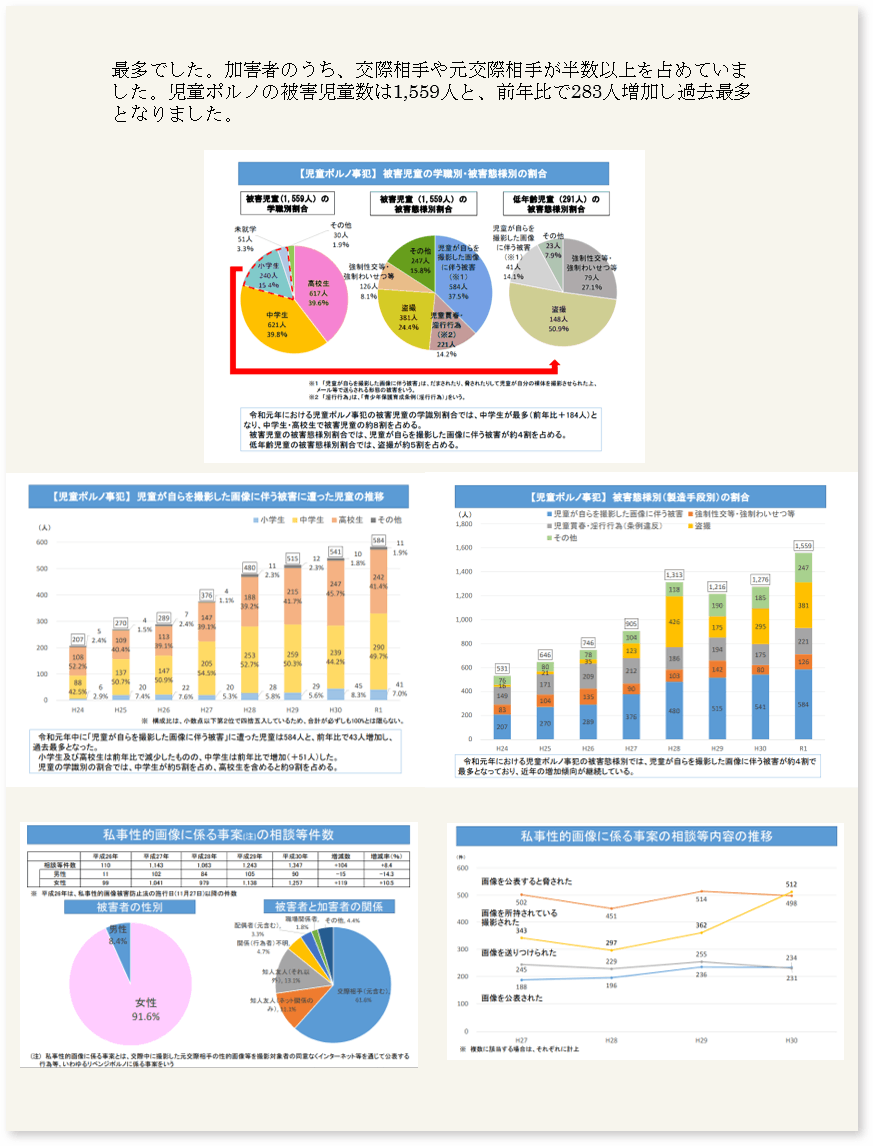

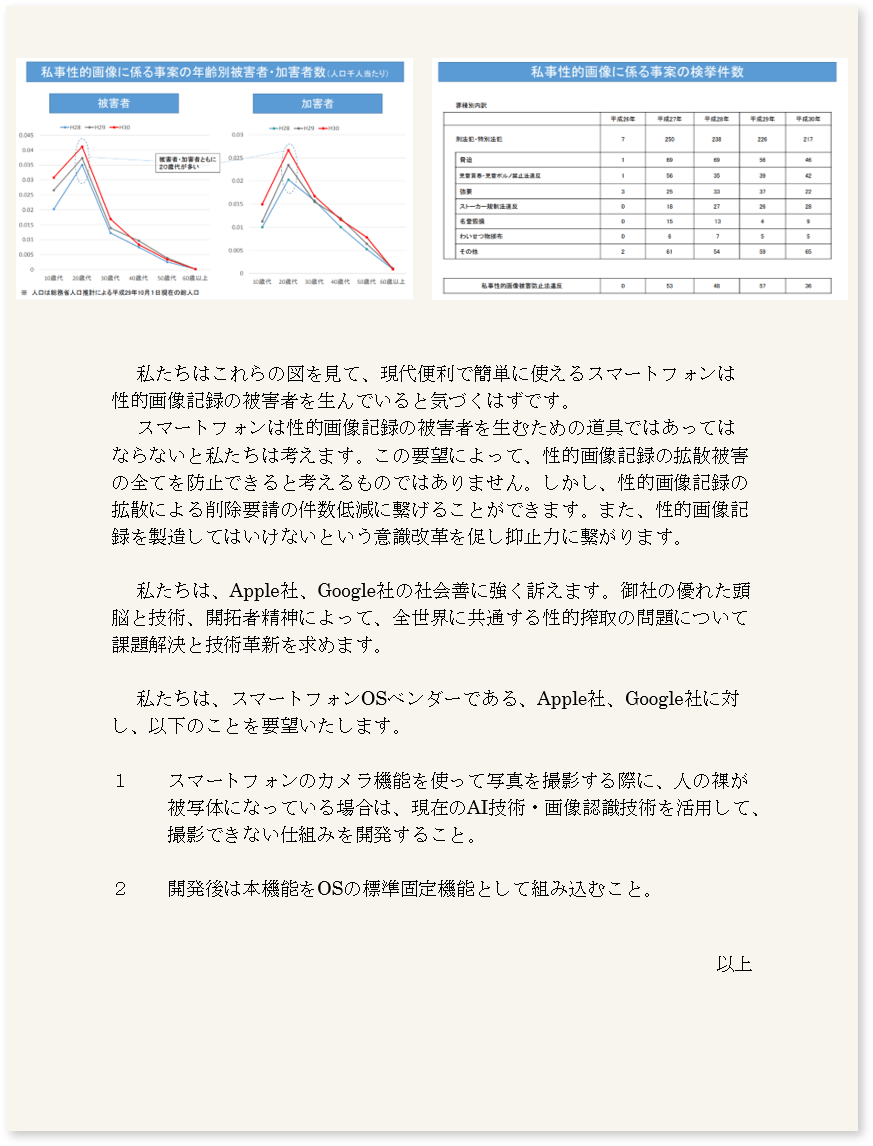

令和元年度警察庁資料

令和元年度警察庁資料

ーー 児童ポルノ事犯で中学生が最多というのは、ショックを受けます。この、自ら撮影したというのは、いわゆるセルフィー(自撮り)が事件になったということでしょうか?

金尻 いわゆる自撮りと言われる被害の相談も月数件寄せられます。自撮りと言いますが、実際は、相手方から性的な写真を送るように言われて、嫌われたらどうしようと恐れ、断われずに送ってしまうケースがほとんどです。特に児童の場合は、”そんなことをする子ども”だと親に思われたくないがために、誰にも言えずに独りで抱え込んでしまい、その後、更なる犯罪に巻き込まれてしまう方もおられます。 ーー 画像がインターネットに拡散された後、削除はどのように行われるのでしょうか?

ーー 画像がインターネットに拡散された後、削除はどのように行われるのでしょうか?

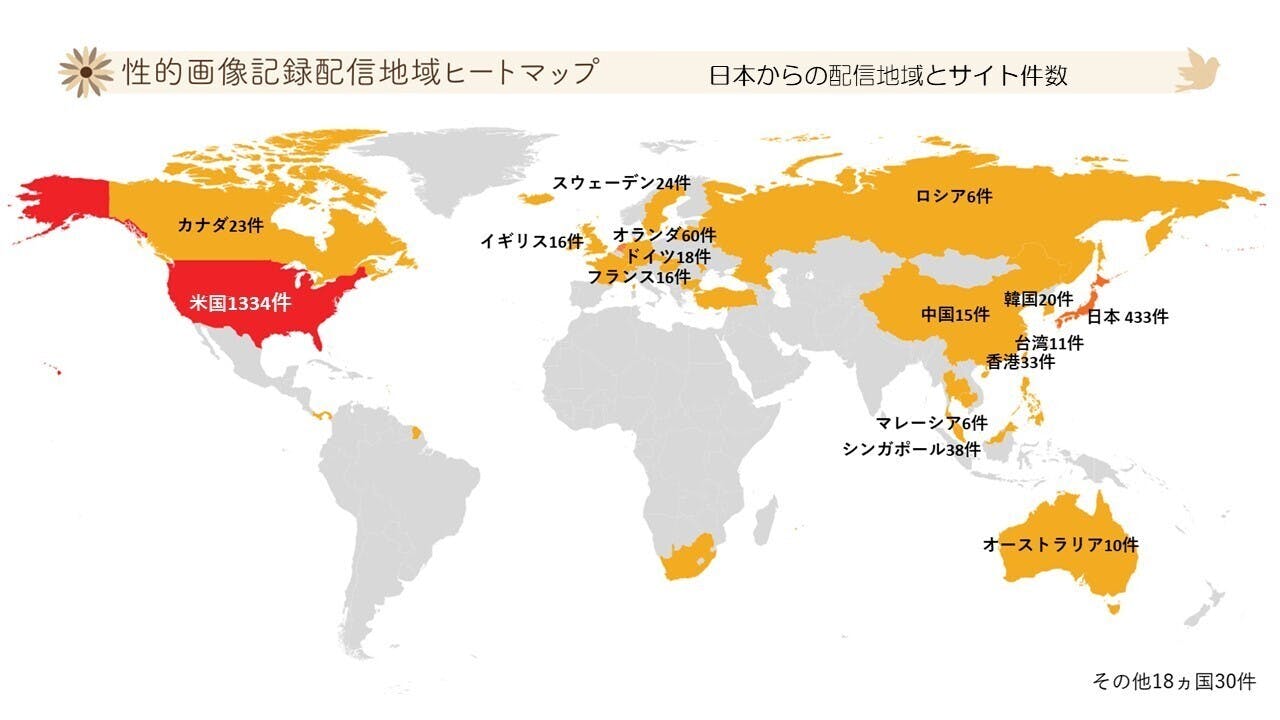

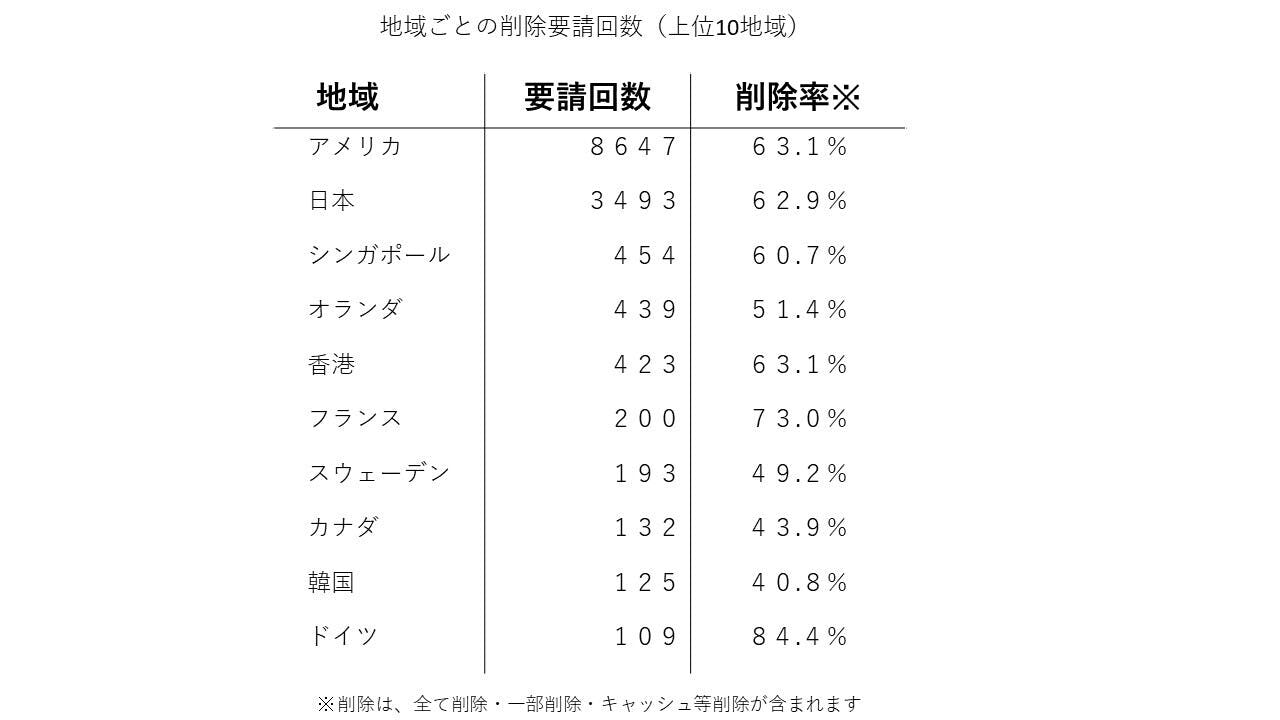

金尻 拡散した画像や動画を自分自身で探して確認することは、精神的な苦痛をともない、二次被害に及びます。ぱっぷすは相談者と相談者の家族の方から委任を受け、人海戦術でインターネット上に拡散してしまった性的画像記録を探し出し、サイト運営者と交渉しますが、応じない場合はホスティング・プロバイダーや通信事業者に連絡を取ります。被害を受けた相談者みずから通報をしないで済む独自のシステムを構築しており、数々の被害のケースを扱ってきました。 性的画像記録の削除要請では、国外サイトが過半数を占めています。

米国に設置された性的搾取サイトの多くは、日本国内向きに配信されており、中にはIPアクセス制限などにより、国外からは閲覧できないようになっているケースもありました。米国のネバダ州はわが国では違法とされるわいせつ物は州法の軽犯罪法に抵触しますが運用されておらず、実質的に合法として扱われており、そこを登記上の隠れ蓑にし、シリコンバレーにレンタルサーバーなどを借りて日本国内向けに配信している事業者を複数確認できています。

国内のホスティングサーバーを中心とするインターネットサービス事業者の多くは、削除要請に対して柔軟に応じますが、しかし、米国に子会社を設けて隠れ蓑とし、実態はオフショアホスティングを提供している事業者もあり、米国法人なので米国宛に送るようにと極めて消極的な対応をとりながら、削除要請に応じないケースがあります。

ーーオフショアホスティングとは?

金尻 法的な管轄を海外に置くことで、国内法が及ばない地域、法執行が緩い地域に設置されたホスティングプロバイダーを用いて、日本国内向けに性的画像記録の配信を行うのです。オフショア地域というのは、ベルヌ条約加盟国ではないことによって、著作権者側からのコンテンツ削除要請に対応する義務が発生しません。それらではサービスの決済方法として、匿名性の高い仮想通貨がもちいられているものもありました。

特にこのようなサイトは、回線速度が遅いことから、CDN(コンテンツ・デリバリー・ネットワーク)を用いて高速化しているサイトも見受けられました。CDN自体は、映画など大容量のストリーミングコンテンツをインターネット配信するために高度に分散されたサーバー群のことを指します。CDNの特徴として、利用者は自分の居場所から最短距離のCDNサーバーを探し、そこからキャッシュされたコンテンツ配信を受けることができ、回線速度の向上を図りますが、一方で、本来配信されているサーバーからは配信されずCDNサーバーから配信を受けるため、本来のサーバーの匿名性が高まります。

CDNのなかで最多なのがCloudFlareでした。CloudFlareは利用者情報の開示はしませんが、本来配信されているサーバー情報は返却するため、その情報のサービスプロバイダー名をもとに削除要請を行う必要があります。しかし、これもまたCDN経由でしか確認できないので自社がホスティングしているサーバーからの配信なのかどうか、わからないことがありました。

ーー 削除を要請できるまでの道のりは平坦ではないということですね。

金尻 そうですね。オフショアホスティングプロバイダーも、登記上はオランダ、実際のサーバー自体はロシアのデータセンターと、英語でのコミュニケーションが取れないこともあったり.....。国内からのIPアドレス以外のリクエストを受け付けられなくしているサーバーもあり、削除要請を受けるサービスプロバイダーにとって、性的画像記録の証拠の確認が取れないということになり、ぱっぷすでは国内IPアドレスが割り当てられたプロキシサーバーを用意し、日本からアクセスがあったかのように中継局を介して確認してもらったことがありました。

ーー サイト管理者やインターネット事業者に削除要請をかけてからは、いかがですか?

金尻 発信者情報開示請求訴訟を行う場合は、被写体の同定可能性といって、被害者が自分であることを証明する客観的な資料が必要になるのですが、性的画像記録と同じ姿態で確認する必要があるなど、被害者の二次被害を無視した対応を求められているのが現状です。当団体では、司法で通用するように、当時の被害状況を詳細に聞き取り、記録を作ることを通して支援します。

被害当事者が直面する困難は他にもあります。身分証明書の提示がなければ削除に応じない事業者があることです。デジタル性暴力の被害者は、映像や画像と本名および住所が関連付けられて再び拡散することを恐れています。性的画像記録を投稿する側は、メールアドレスとパスワードのみで、ほぼ匿名に近い状態で簡単にアップロードすることができるというのに、被害を受けている側だけ個人情報を開示することはまったく理に適っていません。

ーー さいごに、刑事事件化について、どのようになっているかお聞かせください。

金尻 現行法では、いわゆる無修正動画を頒布・販売したものが主犯で、撮影者は従犯となります。そのため、主犯が特定できないと撮影者を逮捕しづらい問題があります。主犯情報を保有する委託販売サイトは、海外にあるために情報開示に消極的で、野放しの状態が続いています。リベンジポルノとアダルトビデオの境界線もなくなってきており、法執行が追い付いていません。委託販売サイトへの投稿者が撮影者と異なる場合、主犯は投稿者と販売者ということになりますが、投稿者が特定できなければ事件化は厳しいといえます。しかし、被害者が希望する場合は、当団体の別の支援事業を通じて事件化支援を行っています。

ーー学齢期の子どもまでが、リベンジポルノや盗撮、自撮りの性的画像記録を撮影し、インターネットにアップできるという、簡単さ、軽さと恐ろしさについて、よく考えないといけないと思いました。一方で、ぱっぷすでは相談者からの相談を受け、画像や動画の映像をひとつひとつ探し出して特定し、物理的にも手間がかかり、心理的にも厳しい削除要請をしています。この高度な高速通信社会のおなじ文明の利器の表と裏で、その違いはあまりにも対比的です。

金尻 ぱっぷすの削除要請事業に関心を寄せていただき、ありがとうございます。ぱっぷすは、性的搾取に遭われた方の相談支援を通じて、性的搾取のサイクルを断ち切るために闘っています。自主性や自由という名のもとで社会が当事者に自己責任を追及している裏で、多くの方々が心身に深い傷を負っています。インターネットで「拡散した写真 削除」などと検索すると、高額な費用で削除を請け負う事業者がいて、トラブル相談も後をたちません。これは被害を受けた方の弱みに付け入る性的搾取の一つだと考えています。被害を受けた側が、身元を開示し、お金を払い、削除要請する社会というのは、とても残酷な社会ではないでしょうか?

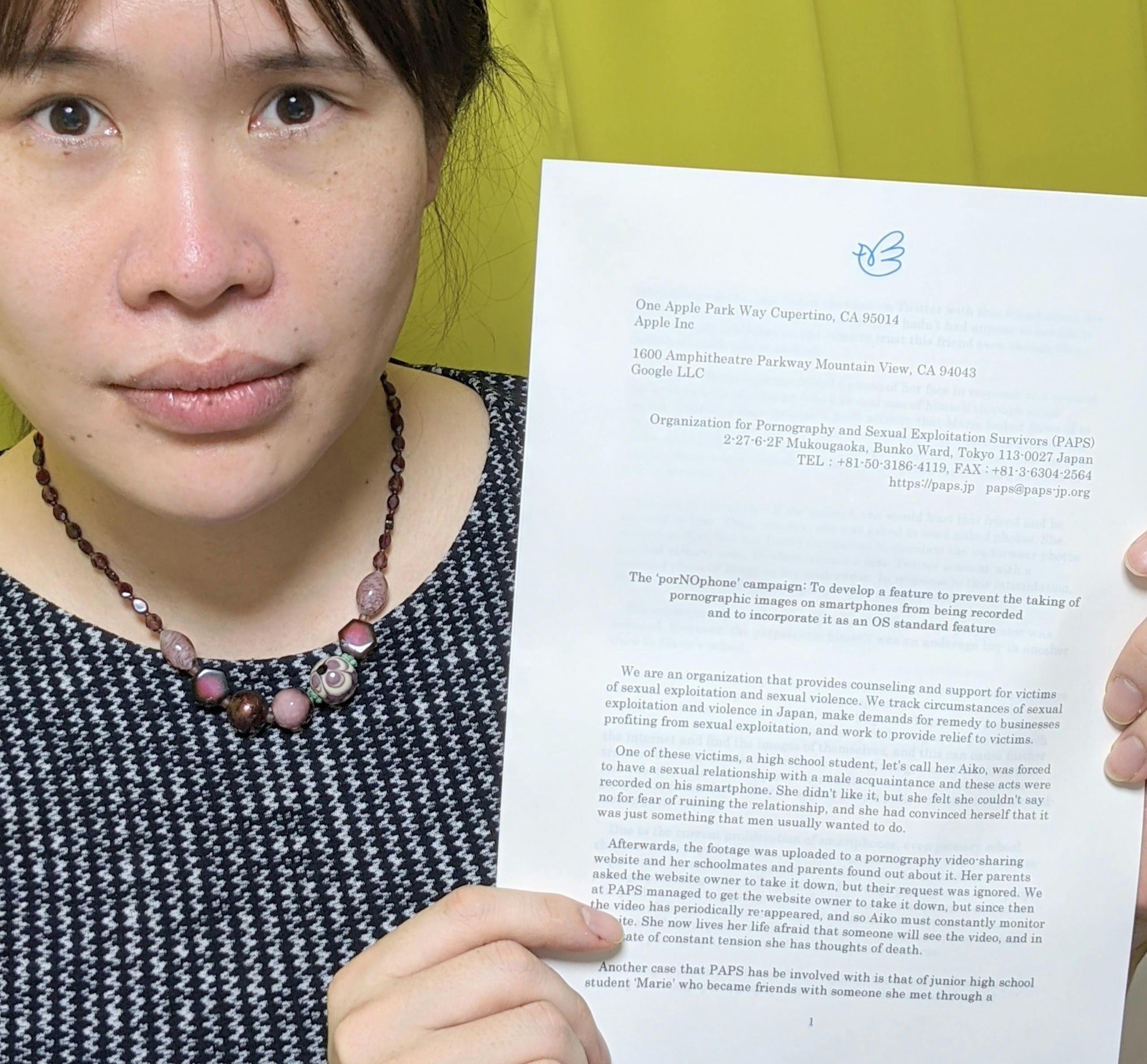

ぱっぷすと連携団体は

iOS配布元 Apple、Android配布元 Google

スマホOSベンダー2社に

要望書を提出いたします。

AIを用いた画像認識技術によって、スマホでは

デフォルトで性的画像記録を撮影できないよう

OS開発とOS標準機能組み込みをお願いするものです。

この要望書にみなさまのお声を揃えて

ムーブメントを起こしたい!という思いを

ハッシュタグにこめました。

#porNOphone

キャンペーンを敷いて、ひとびとの目に

触れながら

いろんな意見を掻き立てながら

いっしょに考えてもらいたい。

テクノロジーが実現する社会の向こうに

皆が幸せになれる

人権意識の芽を育ててもらいたい。

要望書の提出を応援していただけますように、

キャンペーンを少しでも盛り上げていけますように、

ご支援をお願いいたします。

よろしくお願いします。

いただいたご支援は、以下のために

使わせていただき

さらなるご賛同の声を集めてまいります。

キャンペーン広告費:

駅広告およびキャンペーングッズ制作

(駅広告は首都圏から始め、資金に応じて広域に展開します)

キャンペーンスタッフ人件費

※クラウドファンディング手数料14%+税を含みます。

返礼品ご不要のコースも含め、どれをお選びいただいても金額の上乗せができます。

オリジナルTシャツ

ゼムクリップ

マウスパッド

大塚咲 アート作品(www.otsukasaki.com)

ぜひTシャツを着たり、リターン品と一緒に写真

を撮り#porNOphoneのハッシュタグをつけて

SNSにご投稿ください。

プロジェクトを多くの人に知ってもらうために、本ページ

https://camp-fire.jp/projects/335757/ をシェアしてくだされば幸いです。

物販のほかに、

専門集団の強みを生かした他では味わえない体験型リターンもご用意しました。

秋葉原・吉原ツアー

ITセキュリティ講座

出張講演

いただいたメールアドレスに、

要望書提出のご報告、活動報告などの追加情報をお送りいたします。

※本プロジェクトはAll-in方式で実施します。

目標金額に満たない場合も、計画を実行し、お選びいただいたリターンをお届けします。

【 リターンにご提供いただいた、アート写真について 】

・・・続きはこちらで

・・・続きはこちらで

https://note.com/otsukasaki/n/n54d496b41f6b

デジタル性暴力(デジタル性犯罪/デジタル性被害)は、現代特有の特殊な背景を持つ新しい暴力です。わたしたちの社会はまだこの問題に向きあうことができていません。社会モデルによる解決の見通しがないうえ、被害者への帰責化がやみません。事の重大さが認識されがたく、プライベートにかかわるので全容を把握しづらいということも、問題圏を見えにくくしています。

デジタル性暴力(デジタル性犯罪/デジタル性被害)は、現代特有の特殊な背景を持つ新しい暴力です。わたしたちの社会はまだこの問題に向きあうことができていません。社会モデルによる解決の見通しがないうえ、被害者への帰責化がやみません。事の重大さが認識されがたく、プライベートにかかわるので全容を把握しづらいということも、問題圏を見えにくくしています。

前例のないスマホ社会

途上国の地域的な一部を除いてスマホの所有者は多く、これまでに世界が経験したことのない社会的なツールとしてスマホは定着しました。デジタル性暴力にとくに目を向けたことがなければ、当プロジェクトに抵抗を感じる方も少なくないと思います。

その理由の一つには、機会の制限に対する心理的な抵抗があるかもしれません。制限ではなく、本人の意思による選択の自由があったほうがよい、と考えるなどの場合です。表現の検閲に繋がるという心配もあるでしょう。わたしたちの社会はまだ、拡散・流通と、一回的な表現の自由や価値判断との関係について、スマホの上では何が起こるかをよく知らないのです。

機会の制限

いま、デジタル性暴力に関わる機会は、常時、無限で、永久でさえあります。この問題は、節操のない機会にたいして、選択を誤る数が非常に多すぎるという事実から出発しています。

カメラのシャッターを切る機会と、サイト投稿やSNS送信の機会が、組み合わさっただけ、とは言えません。スマホが道具や手段にとどまらない性格を持っているからです。

スマホは信頼や承認、証明、社会的な繋がりのツールであるとともに、消費・経済活動におけるサービスを享受するアイテムです。スマホはユーザーにとって社会でありアイデンティティなのです。

そして、素早く、簡単にフィードバックを与えます。デジタル性暴力の加害も自撮り被害も、客観的なステップや時間を挟まずに起こるのです。

この問題について、自由という名目のもとに、写真や映像にそなわる公衆性や、使い途次第の道具観、当事者の自己責任論、保護者や学校の監督責任論に帰して済むと考える人は、この問題の固有性を無視し、経験則によって問題を一般化し、被害の程度を浅く見ています。

AIの役割

あるいは、テクノロジーが機会を選択するのは不自然だ、選択は人間がするものだ、と感じる人がいるかもしれません。これは重要なテーマです。

AIには、機会を選び間違えないこと、人間の意思決定を助けることが期待されていますが、AIの促した行動から、また人間も学習することができます。

人間の行動は必ずしも正しくないものですが、場合によっては正しくないことがより重要な意味を持つこともあるでしょう。例えば戦闘ロボットと人間の兵士のとる行為の違いなどです。

わたしたちは行為の意味をいっそう明確に意識できるようになります。判断をよけいに挟むことについて、煩わしいと感じる時とまったく同じことが、すでに、便利と感じるテクノロジーの中でも行われています。

今後、社会のフェーズが変わるときに、AIが関わらないということは考えにくい時代になるでしょう。

流出、拡散に対するもう一つのアプローチ

どこでどの端末によって撮影されたか、すべてのデジタル撮影データの出自が、さまざまなアプリケーションを経由してもなお画像に紐づけられているとしたら、それは、管理社会の最先端の姿にちがいありません。そのような未来の技術をあなたが望むかどうか、わたしにはわかりません。

自然体を好み、曖昧さを残しておきたいという心理が、「AIの判断で撮影できないけれど、撮る気になれば単体のカメラや外部アプリによって撮れる」という曖昧さについては受け入れたくない。ところが、上記のような目に見えないデータ流通管理には、案外すんなり馴染んでしまうというのは、ありそうなことです。

しかし、この技術の実現はいまのところ困難でしょう。当プロジェクトは、ヌードやポルノのスマホ撮影に敷居を設けるものであり、流通管理・監視とは関係がありません。

日本の通信サービス会社では、独自開発によるAIを搭載したスマホカメラによって、ヌードかそれに近い撮影ができない端末をすでに販売しています。市場の数多くの商品から、わたしたちはそれを選択できる段階にあります。

人々がスマホのカメラに求めることは何でしょうか。常に持ち歩き、様々なアプリからアクセスでき、 気軽に撮影できる、簡単に加工でき、共有できる、整理できる、写したものをウェブ検索できる、リアルタイムで同期できる、などでしょうか。

多くの人々が便利と感じる機能をそなえたスマホカメラには、機械学習の上に成立した、超解像技術の画像処理が存在しています。

そのように不自然な夜景の撮影ができるうえ、ヌードやポルノを撮影できないスマホカメラが、より多くの人にとって重要でないならば、その理由は何でしょう?

カメラ愛好家に、アート写真を撮るなと言っているのではありません。

医師が記録写真を撮れなくなるわけでもありません。

あなたはメーカーのカメラを使うか新しいアプリをスマホに入れて、きっと必要な行動を取ることができます。しかし、あなたや知人のお子さんが、今手にしているスマホで、加害者になることも被害者になることもあります。いま、少し変わることが出来れば、次世代の社会はもっと変われるという思いから、わたしたちは当プロジェクトを立ち上げました。

温かいご支援を、心よりお願い申し上げます。

porNophoneキャンペーン

イノベーションコンサルタント 谷とも子

【プロジェクトスケジュール】

2021年2月初旬

クラウドファンディング終了

Apple米国法人、Google米国法人に要望書提出

2021年3月

支援金授受および支援者様リスト作成

上記2法人との経過報告を開始

2021年5月~

リターン配布および体験型リターンの打ち合わせ

東京メトロ駅構内ポスター広告

最新の活動報告

もっと見る

28日深夜2時 NHK BS2 映画『SNS少女たちの10日間』紹介に、ぱっぷすが取材されました

2021/04/29 00:35チェコ映画「SNS 少女たちの10日間」が劇場公開されました。日本国内の配給情報が出たのは、昨年、このクラウドファンディングの直前でした。じつは、クラウドファンディングページへの掲載の許可をいただけませんか、と、このとき、配給会社に問い合わせたのです。残念ながら、クラウドファンディング掲載は、権利元から許可されている権利の範疇を超えてしまう、というお返事でした。28日の深夜2時、NHK BS2で映画の紹介があり、そこで日本の実情としてぱっぷすが取材されました。スピンオフのような出来事でした。映画を期に、少しずつでもみなさんがデジタル性暴力を知って、いますぐ相談できること、そして未来は変えられることを思い出して欲しいです。『SNS ₋少女たちの10日間₋』公式サイト http://www.hark3.com/sns-10days/ もっと見る

Apple, Google米国法人に要望書を提出しました!

2021/02/27 12:36署名を添えて、2月26日付でレターを郵送いたしましたことをご報告させていただきます。内容は下記のとおりです。The ‘porNOphone’ campaign: To develop a feature to preventthe taking of pornographic images on smartphonesfrom being recorded andto incorporate it as an OS standard featureWe are an organization that provides counseling and support for victims of sexual exploitation and sexual violence. We track circumstances of sexual exploitation and violence in Japan, make demands for remedy to businesses profiting from sexual exploitation, and work to provide relief to victims.One of these victims, a high school student, let’s call her Aiko, was forced to have a sexual relationship with a male acquaintance and these acts were recorded on his smartphone. She didn't like it, but she felt she couldn't say no for fear of ruining the relationship, and she had convinced herself that it was just something that men usually wanted to do.Afterwards, the footage was uploaded to a pornography video-sharing website and her schoolmates and parents found out about it. Her parents asked the website owner to take it down, but their request was ignored. We at PAPS managed to get the website owner to take it down, but since then the video has periodically re-appeared, and so Aiko must constantly monitor the site. She now lives her life afraid that someone will see the video, and in this state of constant tension she has thoughts of death.Another case that PAPS has be involved with is that of junior high school student ‘Marie’ who became friends with someone she met through a smartphone game. She began chatting on Twitter with this friend about her daily school life and various problems. She hadn’t had anyone in her life to chat to about problems, so she came to trust this friend even though they hadn’t actually met in real life.One day, Marie sent the friend a photo of her face in response to a request for a photo from this friend who had sent one of himself through social media. Sending photos became a daily activity that Marie looked forward to as an emotional comfort in loneliness, and the friend would compliment her looks, and the photos would become a topic of conversation between the two online. Marie was eventually goaded by this friend into sending pictures in her underwear.Marie was afraid that if she refused, she would hurt this friend and be rejected by him. Then, one day, she was asked to send naked photos. She refused at first, but her friend threatened to circulate the underwear photos she had already sent. He then created a fake Twitter account with a doctored photo of Marie in her underwear. In response to this intimidation, Marie sent the friend a naked photo taken on her phone.She subsequently consulted with us at PAPS, and the perpetrator was arrested. However, the perpetrator himself was an underage boy in another class at Marie’s school.When child or revenge pornography is released to the Internet in the ways shown in these examples, it is virtually impossible to remove, and its damage to victims can continue for 10 or 20 years. Further, in order for a victim to take action to demand removal of such images, they must search the internet and find the images of themselves, and this can cause further trauma. Our organization searches for sexual images on behalf of victims and submits take-down requests to website owners, but, even when the images are taken down, they re-appear after a period of time, and a cat-and-mouse game ensues.Due to the current proliferation of smartphones, even primary school children these days have them, and our organization now receives endless requests for consultation over harms arising from the circulation of pornographic images, including child and revenge pornography. The people who produce these images do so easily with their smartphones, and so are unaware of the extent of human rights violation their victims sustain. Almost all of the requests we have received for consultation over revenge and child pornography have involved smartphone cameras.According to Japan’s National Police Agency, the number of calls to police relating to revenge pornography, which involves the release of sexual images or videos without a person's consent, hit a record 1,479 calls in 2019, which was a 9.8 percent increase over the previous year. More than half of the perpetrators were named as dating partners or former dating partners. A record number of children were victims of child pornography, 1,559 victims, which was an increase of 283 children over the previous year. Looking at the statistics in this diagram, it is obvious that smartphones, as convenient as they might be in our convenience-centred societies, are causing children to fall victim or perpetrator to crimes of pornographic image-based sexual abuse.We do not believe smartphones should be the easiest tools that create victims or perpetrators of pornographic images. Our ‘porNOphone’ campaign will of course not prevent all harms arising from the proliferation of these images, but it aims to reduce the number of requests arising from victims for the take-down of materials online. The campaign also serves to raise awareness of the criminality of producing sexually explicit imagines against someone’s will, and also to encourage a shift in social norms towards intolerance of such practices.In launching our ‘porNOphone’ campaign, we appeal to the sense of corporate responsibility that Apple and Google exercise in relation to their products, and ask for their cooperation. We urge Apple and Google to use their brilliant minds, technology and pioneering spirit to solve this problem of sexual exploitation and innovate to address the common problem of sexual exploitation around the world.We ask specifically of smartphone OS vendors Apple and Google the following two points.1. We request that they develop a feature that prevents the recording of naked human beings on smartphone, utilizing AI and image recognition technology.2. After development of this feature, we request it shall be incorporated as a standard fixed function of their OS.We raised money through crowdfunding in January. Based on the voices and funds that support our backs, we are going to continue to educate society about the fact of digital sexual violence.When AI stops letting smartphone cameras shoot nudes and pornography, it makes sense for humans to decide whether or not to install a new camera app. It is our sincere hope that AI will be properly involved in the decision-making process as well as keeping the opportunity for crime and mistakes away from our children, even one step at a time.Sincerely もっと見る

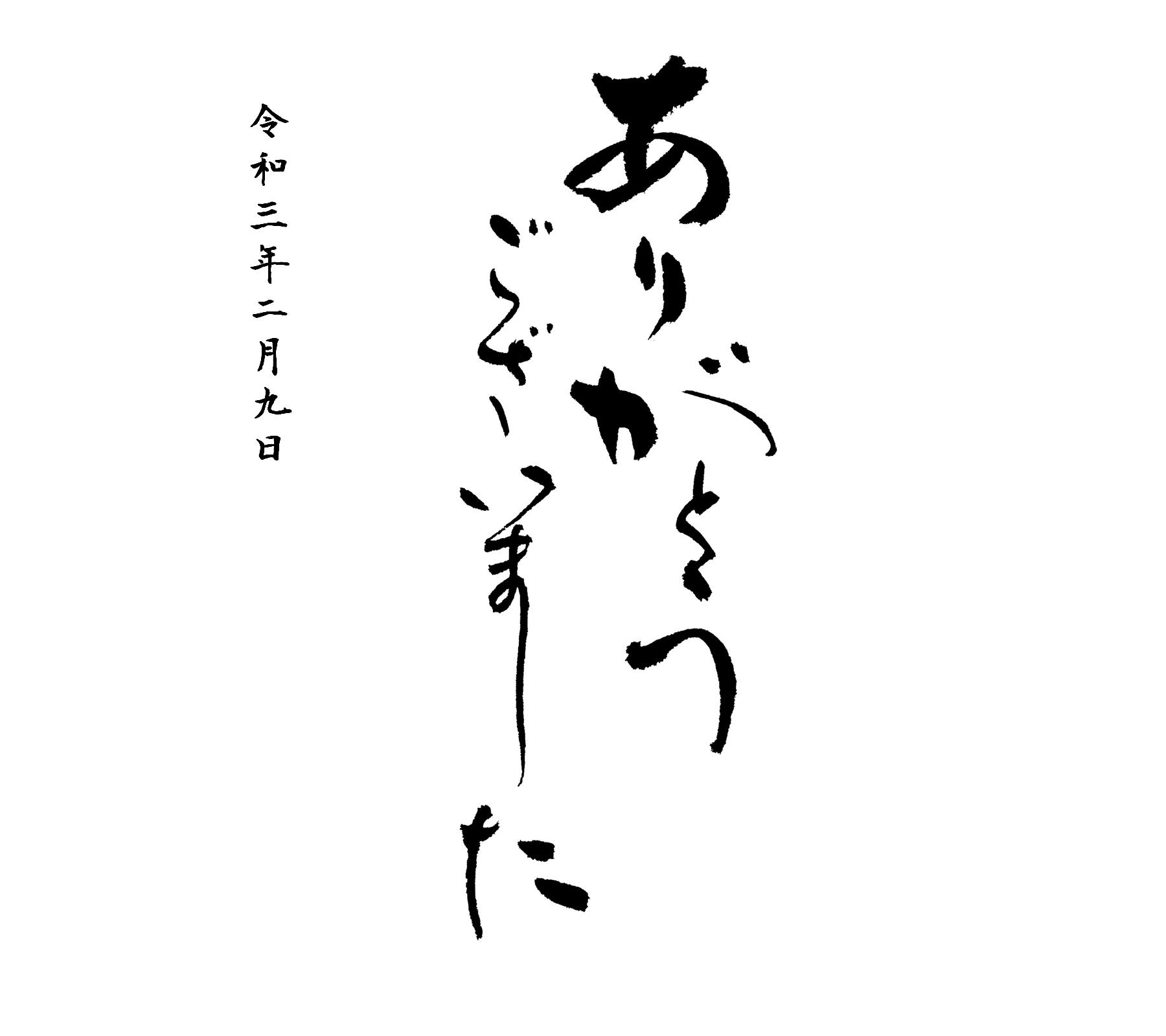

クラウドファンディング終了しました!

2021/02/09 07:00クラファンを初めてからあっという間の2カ月でした。最初の頃はネガティブコメントもありましたが終盤になってから風が少し変わったのを肌で感じました。多くの方からご寄付という形で賛同を得られたことが嬉しく思いました。クラファン終了後は、形に見える進捗と成果を出していかないといけないので、大変になりますが、皆様と一緒に頑張っていけたらと思っています。金尻カズナ もっと見る

何が言いたいのかは理解し同意できるが、解決策としてこの手段にたどり着くのはまったく理解できない。 考えられる限りで最悪の着地点だと思う。

イラネ