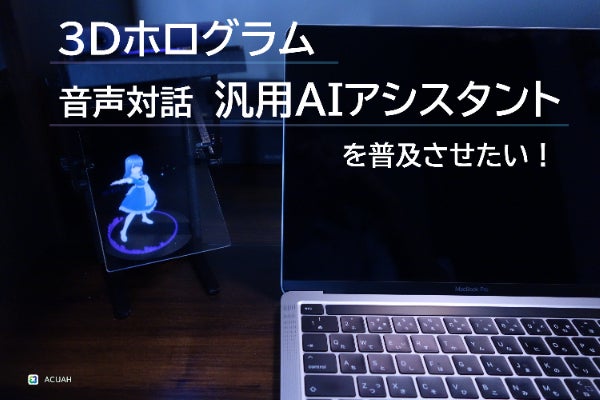

プロジェクトの動機 で記載した「パーソナライズ化できるAIの必要性」についての話になります。前職S社に在籍していた 2019年のことになります。S社は前年「AI倫理ガイドライン」を策定しグループ各社内への展開を行っていました。当時の私は、情報セキュリティ管理業務へも携わっていたことからAI倫理にも関心があり、兼務ながらこのAI倫理活動に参画をさせて頂くことになりました。AI倫理について活動する中で、AIの透明性、説明可能なAIをどう開発するのかといった内容が日々議論されていたのですが、そうした折、Googleが AI諮問委員会を解散する というニュースが話題に上がりました。(出典:「グーグル、AI倫理諮問委員会を解散--委員をめぐる批判受け」Richard Nieva (CNET News) 翻訳校正: 編集部2019年04月08日 08時10分 )このニュースから、「AIの公平性」について、個人的に以下の考えに至りました。「AI倫理を審査する組織があったとしてもそのメンバーの「人選」をするという行為自体が、実はそもそも公平ではない場合もあるかも知れない。AIの利用が個人に広まっていった際にAI倫理はどうなるのか。最終的にはAIを使う個々人が自分の倫理観で責任をもってAIを育てるような仕組み(パーソナライズ化できるAI)を作ることでしかAI倫理の問題は解決できないのではないか。」活動報告「AIの出力と「正しさ」」の中では以下のように表現しました。各AI開発会社は期待した「正しい」回答を得られるように、評価値(正確性、信頼性)が高いAIを開発していますが、結局、それらは他者が開発したAIである以上、その評価をしている人や組織が考える「正しさ」から逃れることはできません。本プロジェクト"ACUAH"で考えているパーソナライズ化の手法については、活動報告・対話シナリオとは・AIの出力と「正しさ」・対話シナリオとAIを組み合わせた仕組みでご説明させていただきました。(現時点での仕組みの一部です。)今後、AIが安全に民主化されていくためには、 ✔ ユーザーが自身の倫理観でAIの出力結果を評価してパーソナライズ化する仕組み ✔ ユーザーがパーソナライズ化されたデータを編集管理できる仕組み ✔ 一つのAI開発会社に依存せず、ユーザーが様々なAIを選べるようにすること ✔ アシスタントの行動(出力先)として様々な手段・技術に連携できることが最終的には必要と考えています。そして、これを実現するためには、本プロジェクト「(世界普及率70%近い)スマートフォンそのものをバーチャルヒューマンのような汎用AIアシスタント にする」ことが近道になる筈です。【注意】ACUAH は 汎用AIアシスタントのため、上記のようなパーソナライズ化の手法(対話シナリオとの組み合わせ)を用いず、AIのみで利用することも可能になっています。ユーザーご自身の考えでご利用ください。